Was heute fehlt

Langfristige Haushaltssequenzen, Manipulationsspuren mit mehreren Kameras, taktile Greiffehler, Interventionsdaten und Bewertungsdatensätze, die an reale Einsatzbeschränkungen gebunden sind.

Eine hochkarätige Versammlung zum nächsten Engpass in der Robotik: welche Daten noch fehlen, Was Teams als Nächstes sammeln müssen und wie Hardware, Teleoperation, Annotation, Auswertung usw. verbunden werden können. und Bereitstellung in einem echten Betriebskreislauf.

Wir wollen einen Raum, in dem Labore, Startups, Betreiber und Systembauer ihre Meinungen darüber austauschen können, was ist In verkörperten KI-Datensätzen fehlen noch: Fehlerdaten, taktile Signale, Randfälle, Wiederherstellungsspuren, menschliche Korrekturen, Flotten-Feedback und domänenspezifische Arbeitsabläufe.

Langfristige Haushaltssequenzen, Manipulationsspuren mit mehreren Kameras, taktile Greiffehler, Interventionsdaten und Bewertungsdatensätze, die an reale Einsatzbeschränkungen gebunden sind.

Welche Datenmodalitäten jetzt am wichtigsten sind, wie weit die Simulation allein gehen kann, wo Annotationsstandards noch immer brechen und welche neuen Benchmarks das Ökosystem tatsächlich benötigt.

Eine klarere Karte des Robotik-Datenstapels, praktische Erfassungs- und Anmerkungsmuster und konkrete Möglichkeiten, den Hardwarezugriff in schulungsbereite Datensätze umzuwandeln.

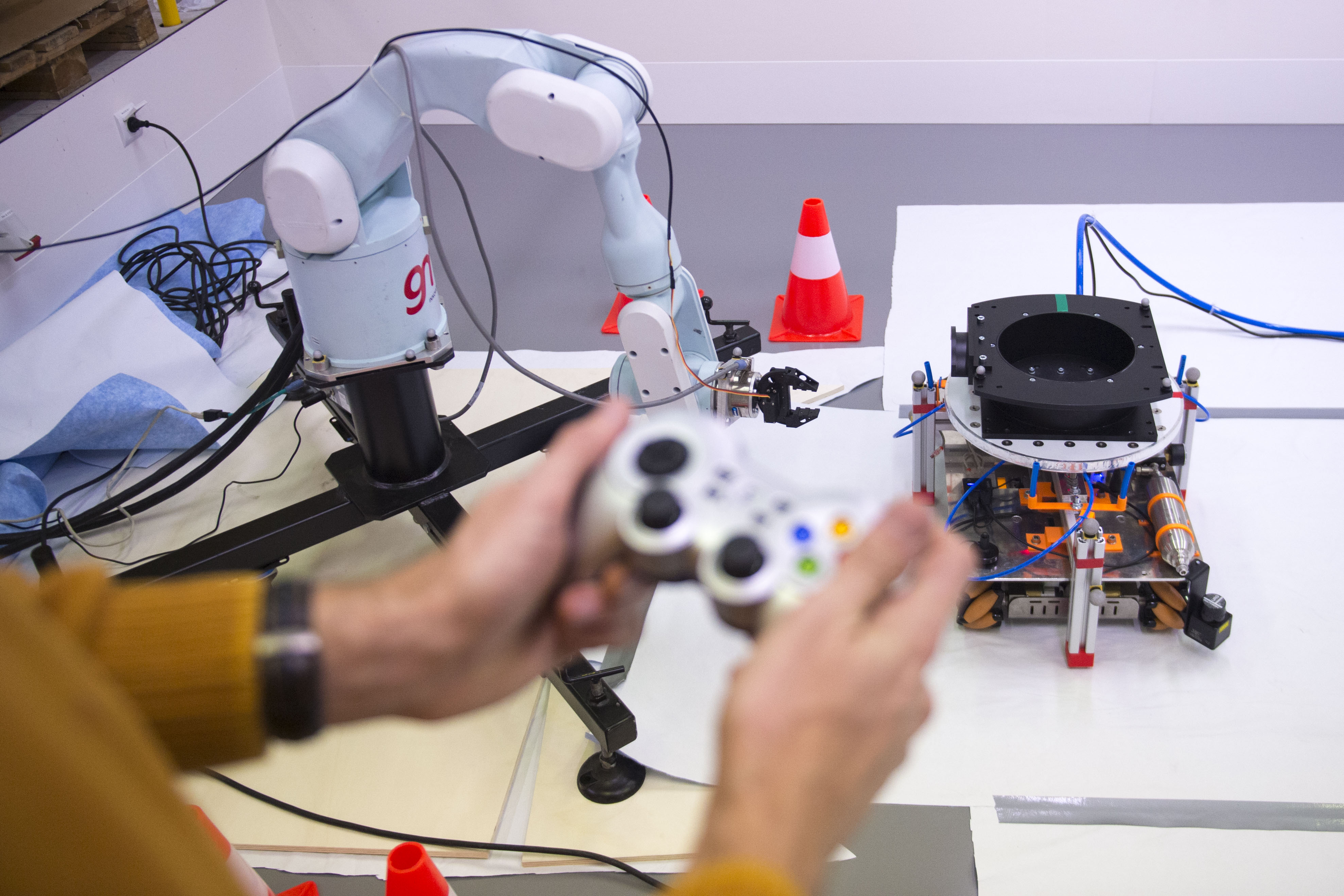

Nicht nur Folien. Echte Roboter, Datenerfassungsgeräte und Arbeitsabläufe der Bediener vor Ort.

Sichtbar, erschwinglich und praktisch zum Sammeln von Manipulationsdemonstrationen, Bedienereingriffen und schnellen Aufgabeniterationen.

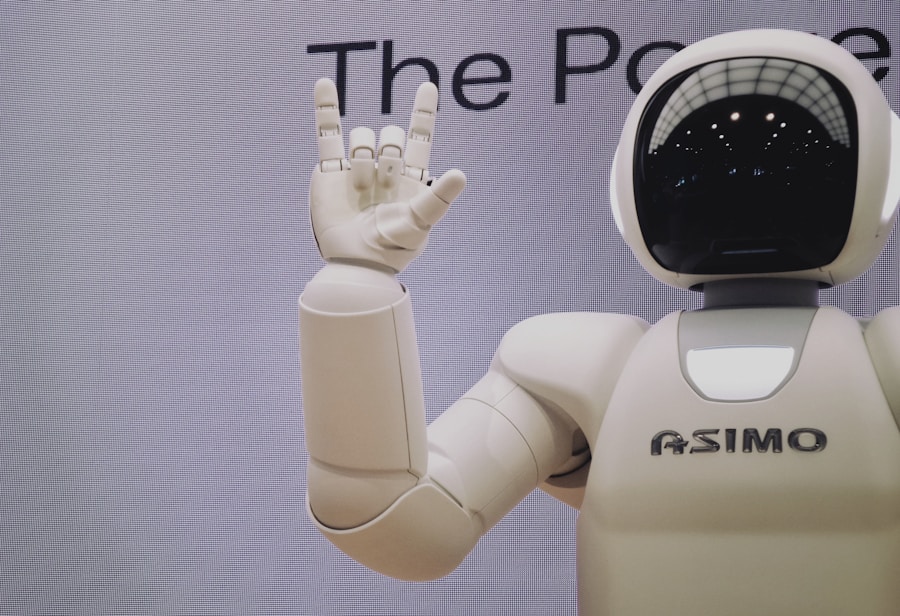

Wie hochwertige humanoide Daten jenseits isolierter Clips aussehen: Absicht, Gleichgewicht, Kontakt, Wiederherstellung und Überwachungskosten.

Wie Teams mit Teleop, Richtlinienbewertung, Anmerkungs-QA und Feedback aus der Praxis von Demos zu wiederholbaren Datenpipelines übergehen.

Fehlerspuren, Unsicherheitsbezeichnungen, Wiederholungsversuche, taktile Interaktionen und Sequenzen, in denen Menschen eingreifen oder eine Richtlinie korrigieren.

Lange Videos, dichte Manipulationszustände, multimodale Ausrichtung, politische Absicht und Ereignisbezeichnungen, die eher operativ als visuell von Bedeutung sind.

Gemeinsame Schemata, umfangreichere Metadaten, Annahmen zur roboterübergreifenden Übertragung, Teleop-Herkunft, Umgebungs-Tags und Benchmark-fähige Struktur.

An das Bereitstellungsrisiko gebundene Offline-Qualitätssicherung, Benchmark-Abdeckung für Grenzfälle und Schleifen, die Rollout-Beweise wieder mit Sammlungsprioritäten verbinden.

Wir wollen keinen Gipfel, der bei „Daten sind wichtig“ stehen bleibt. Wir möchten zeigen, welche Full-Stack-Teams Folgendes nutzen können: Hardwarezugriff, Teleoperation, multimodale Erfassung, strukturierte Annotation, Qualitätssicherung und eine Plattform, die den Kreislauf am Laufen hält.

OpenArm, Humanoide, Hände und mobile Systeme, die aussagekräftige Interaktionsdaten statt reiner Spielzeugspuren generieren.

Teleop, Kameraansichten, Statusströme, Interventionsprotokolle und Sitzungsmetadaten, die Ihnen sagen, wie sich eine Aufgabe tatsächlich entwickelt.

Aufgabenrubriken, Prüferrollen, Ablehnungsgründe, versionierte Anmerkungen und ein klarerer Weg von Rohmedien zu lernbereiten Assets.

Nutzen Sie Plattformtelemetrie, Episodenverlauf und Fehlerüberprüfung, um zu entscheiden, was als Nächstes erfasst werden soll, anstatt nur auf Ihre Intuition zu warten.

Die Demo-Etage beginnt mit Roboterstationen, Beispielen für die Datenerfassung und Komplettlösungen für die Plattform.

Forscher und Betreiber vergleichen die Lücke zwischen aktuellen Datensätzen und dem tatsächlichen Bereitstellungsbedarf.

Kurze, konkrete Vorträge zu taktilen Daten, teleopischer Überwachung, Auswertungslücken und Annotationsengpässen.

Teams können eine integrierte Sitzung zu Erfassungs-, Schema-, Qualitätssicherungs-, Anmerkungs- und Speichermustern sofort übernehmen.

Benchmarks, gemeinsame Formate, fehlende Modalitäten und was das nächste Jahr der Robotikdaten wirklich besser machen könnte.

Treffen Sie Forscher, Hardware-Teams, Datenbetreiber und Unternehmen, die verkörperte KI-Stacks entwickeln.